Veille Technologique MCP – Semaine 8 2026 : Consolidation Enterprise et Débats Communautaires

Cette synthèse couvrait la période du 16 février au 22 février 2026 (semaine 8).

Résumé Exécutif

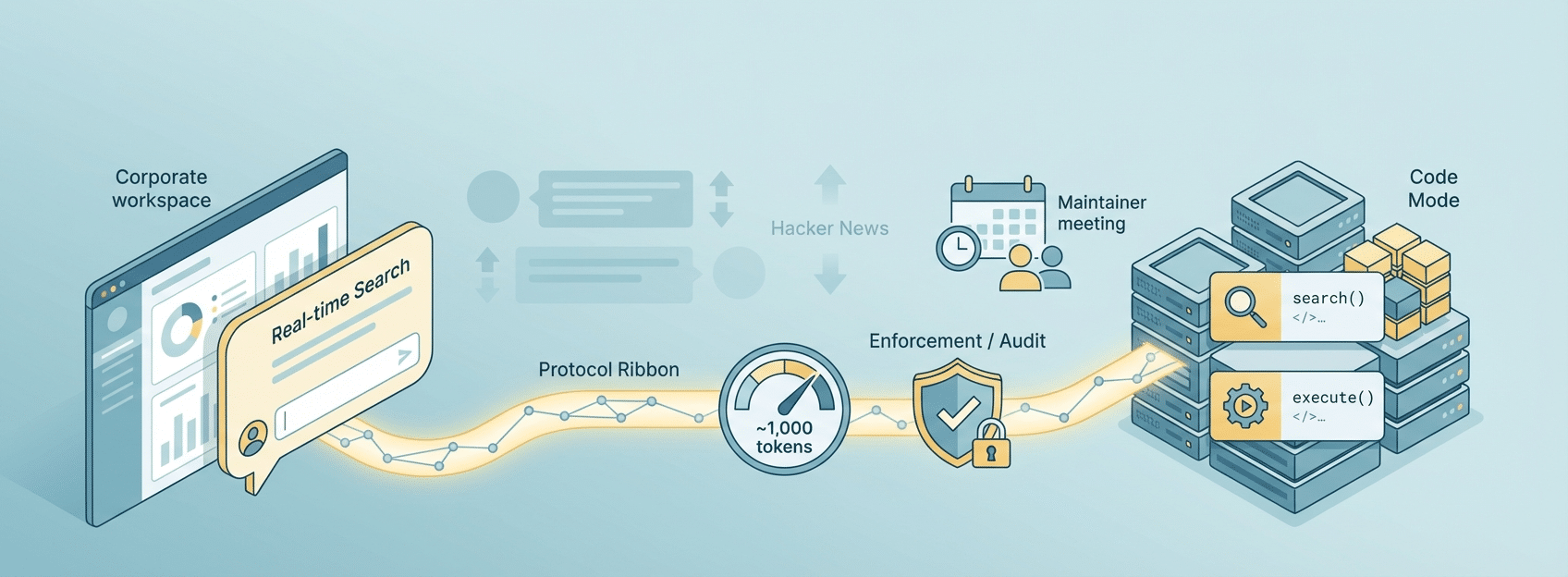

La semaine du 16 au 22 février 2026 a marqué un tournant significatif dans l’adoption enterprise du protocole Model Context Protocol (MCP). Deux acteurs majeurs de l’infrastructure cloud ont officialisé leurs intégrations : Slack a lancé le 17 février son serveur MCP avec une API Real-time Search innovante, tandis que Cloudflare a dévoilé le 20 février son approche architecturale disruptive « Code Mode », condensant l’intégralité de son API en seulement deux outils générique consommant 1 000 tokens. Parallèlement, la gouvernance du protocole progressait avec une réunion des mainteneurs le 18 février, où une proposition « MCP Enforcement Mode » a émergé pour répondre aux besoins d’auditabilité enterprise. Cette période a également été caractérisée par des débats communautaires intenses sur Hacker News concernant la maturité du protocole et sa complexité pour les cas d’usage locaux.

Évolution et Contexte

Contexte de la Période

La semaine du 16 au 22 février 2026 marquait la huitième semaine de l’année 2026, une période qui s’inscrivait dans la phase de consolidation du protocole MCP suite à sa donation à une entité hébergée par la Linux Foundation. Cette semaine d’analyse se déroulait deux mois après le lancement initial du protocole fin 2024, dans un contexte où les acteurs majeurs de l’infrastructure cloud commençaient à évaluer concrètement l’intégration de MCP dans leurs écosystèmes.

Développements Structurants

La semaine a été marquée par deux annonces majeures d’intégration enterprise. Le 17 février, Slack a officialisé son serveur MCP avec une API Real-time Search innovante fournissant des réponses en langage naturel, positionnant MCP comme standard potentiel pour l’automatisation conversationnelle en entreprise. Trois jours plus tard, le 20 février, Cloudflare a lancé Code Mode, une approche architecturale disruptive condensant l’ensemble de son API en seulement deux outils (search() et execute()), consommant uniquement 1 000 tokens contre des milliers pour les approches traditionnelles.

La gouvernance du protocole progressait également avec la réunion des mainteneurs le 18 février, où la proposition « MCP Enforcement Mode » émergeait, répondant aux besoins d’auditabilité des environnements enterprise. Parallèlement, les discussions sur Hacker News révélaient des tensions communautaires concernant la complexité du protocole pour les cas d’usage locaux, contrastant avec sa valeur reconnue pour les services hébergés.

Trajectoire Observable

Cette semaine constituait la première période de veille documentée dans ce système d’analyse. Aucun contexte historique n’était disponible pour établir des comparaisons longitudinales. Cette semaine posait néanmoins les fondations d’une trajectoire observable : l’adoption par des acteurs infrastructure critiques (Slack, Cloudflare), l’émergence de patterns architecturaux optimisés (minimalisme versus prolifération d’outils), et une structuration progressive de la gouvernance post-donation. Les semaines futures permettraient d’évaluer si ces tendances se confirmaient ou si de nouveaux paradigmes émergeaient.

Actualités

Serveur MCP Slack – Lancement Officiel

Date : 17 février 2026

Annonce : Slack a officialisé le lancement de son serveur MCP permettant aux agents IA d’interagir avec les données des espaces de travail Slack via des outils optimisés pour les modèles de langage. L’annonce incluait également la nouvelle API Real-time Search (RTS) qui, contrairement aux API traditionnelles, fournissait des réponses directement en langage naturel.

Fonctionnalités clés :

- Découverte automatique : les agents pouvaient identifier les espaces de travail et canaux disponibles

- Configuration contextuelle : paramétrage des permissions et accès dans un contexte workspace

- Exécution optimisée : interactions standardisées via le protocole MCP

- Réponses en langage naturel : l’API RTS éliminait la nécessité de traiter des structures JSON complexes

Impact technique : Cette intégration représentait la première adoption native d’un outil de collaboration majeur avec MCP, ouvrant la voie à l’automatisation conversationnelle dans les workflows d’entreprise. L’approche de Slack standardisait l’accès aux données collaboratives pour les agents IA, potentiellement réplicable par d’autres plateformes de communication.

Source : Documentation officielle Slack MCP

Cloudflare Code Mode – Serveur MCP Unifié

Date : 20 février 2026

Annonce : Cloudflare a lancé Code Mode, un serveur MCP donnant accès à l’ensemble de l’API Cloudflare (DNS, Zero Trust, Workers, R2, etc.) via seulement deux outils génériques : search() et execute().

Architecture innovante :

- Minimalisme radical : deux primitives universelles remplaçaient des centaines d’endpoints spécialisés

- Optimisation tokens : consommation d’environ 1 000 tokens pour exposer l’API complète (contre plusieurs milliers pour approches traditionnelles)

- Recherche sémantique : search() permettait la découverte d’opérations par requêtes en langage naturel

- Exécution générique : execute() acceptait des paramètres dynamiques pour toute opération API

Exemple d’utilisation :

- Agent : “Créer une zone DNS pour example.com”

- Système : search(“créer zone DNS”) → identifie l’opération pertinente

- Système : execute(operation_id, {domain: “example.com”}) → exécute l’action

Impact technique : Cette approche résolvait élégamment les problèmes de limitation de contexte en condensant des APIs massives en interfaces minimalistes. Le modèle était potentiellement réplicable pour d’autres fournisseurs cloud confrontés à la prolifération d’endpoints API. Cloudflare démontrait qu’une architecture MCP optimisée pouvait réduire drastiquement la consommation de tokens tout en maintenant une couverture fonctionnelle complète.

Source : Annonce Cloudflare Code Mode

Réunion des Mainteneurs Core MCP – Structuration de la Gouvernance

Date : 18 février 2026

Contexte : Une réunion des mainteneurs principaux de MCP était référencée dans les discussions GitHub du repository principal (modelcontextprotocol/modelcontextprotocol). La réunion abordait plusieurs propositions d’évolution du protocole.

Proposition phare : MCP Enforcement Mode

- Objectif : fournir des mécanismes d’audit et de contrôle pour les environnements enterprise

- Fonctionnalités envisagées : traçabilité complète des interactions, validation des permissions, logs d’audit standardisés

- Justification : répondre aux exigences de conformité (SOC 2, ISO 27001, RGPD) pour adoption en production

Signification stratégique : Cette proposition indiquait une structuration croissante de la gouvernance post-transfert Linux Foundation, avec un focus explicite sur les besoins enterprise. L’émergence d’un « Enforcement Mode » suggérait que les retours des premiers adopteurs enterprise (comme Slack et Cloudflare) influençaient directement la roadmap du protocole.

Source : Repository GitHub MCP

Débats Hacker News – Maturité et Complexité du Protocole

Période : 16-22 février 2026

Contexte : Des discussions actives sur Hacker News concernant la donation de MCP à une entité hébergée par la Linux Foundation ont soulevé des questions sur la maturité du protocole (à peine 1 an d’existence à ce stade).

Arguments en faveur de MCP :

- Standardisation nécessaire : MCP fournissait un cadre unifié pour les interactions agent-service

- Valeur pour services hébergés : le protocole excellait pour les agents distants nécessitant un troubleshooting standardisé

- Écosystème émergent : les intégrations Slack et Cloudflare validaient l’approche

Critiques formulées :

- Complexité excessive : pour les cas d’usage locaux, des scripts CLI simples étaient souvent suffisants

- Surengineering : le protocole introduisait de l’overhead pour des workflows personnalisés

- Maturité questionnable : donation prématurée à la Linux Foundation pour un protocole si jeune

- Préférence pour corrections rapides : certains utilisateurs préféraient qu’Anthropic itère rapidement plutôt que standardiser prématurément

Analyse : Ces débats révélaient une tension classique dans l’adoption de standards : la valeur de MCP était claire pour les architectures distribuées et multi-agents, mais questionnée pour les workflows locaux et personnalisés. Cette divergence suggérait que le protocole devait potentiellement évoluer vers des profils d’implémentation différenciés (« MCP Lite » pour usage local, « MCP Enterprise » pour production).

Source : Discussions Hacker News

Tutoriels et Ressources Pédagogiques

Documentation Slack MCP – Guide d’Intégration

Slack a publié une documentation complète accompagnant le lancement de son serveur MCP. Les ressources pédagogiques couvraient :

- Configuration initiale : installation du serveur MCP Slack, configuration des OAuth tokens, paramétrage des permissions workspace

- Cas d’usage typiques : recherche de messages, récupération de contexte conversationnel, automatisation de réponses

- Bonnes pratiques : gestion des rate limits, optimisation des requêtes RTS, respect des politiques de confidentialité

- Exemples de code : intégrations avec Claude Desktop, scripts Python pour automatisation

La documentation insistait particulièrement sur les différences entre l’API Real-time Search (réponses en langage naturel) et les API REST traditionnelles (structures JSON), guidant les développeurs dans le choix de l’approche appropriée selon le contexte.

Public cible : Développeurs d’agents IA, intégrateurs enterprise, équipes DevOps

Cloudflare Code Mode – Démonstrations Vidéo

Cloudflare a accompagné le lancement de Code Mode avec des ressources pédagogiques illustrant l’approche minimaliste :

- Tutoriel vidéo : démonstration de l’architecture à deux outils (search/execute)

- Comparaison tokens : analyse comparative entre approche MCP traditionnelle (outils spécialisés) et Code Mode (outils génériques)

- Cas d’usage infrastructure : automatisation DNS, déploiement Workers, configuration Zero Trust

- Intégration Claude : configuration du serveur MCP dans Claude Desktop pour accès Cloudflare

Les ressources mettaient l’accent sur l’efficacité token et la simplicité d’implémentation, positionnant Code Mode comme référence pour les futures intégrations MCP de fournisseurs cloud.

Public cible : Architectes cloud, SRE, développeurs infrastructure

Développements Techniques

Architecture Minimaliste vs. Prolifération d’Outils

La semaine du 16 au 22 février 2026 a mis en évidence deux paradigmes architecturaux divergents pour les serveurs MCP :

Approche traditionnelle (outils spécialisés) :

- Un outil MCP par endpoint API ou fonctionnalité

- Exemple : cloudflare_create_dns_zone, cloudflare_update_dns_record, cloudflare_delete_dns_zone, etc.

- Avantage : clarté fonctionnelle, typage strict des paramètres

- Inconvénient : consommation massive de tokens (description de chaque outil), pollution de la fenêtre de contexte

Approche Cloudflare (outils génériques) :

- Deux primitives universelles : search(query) et execute(operation_id, params)

- Avantage : optimisation tokens drastique (1 000 tokens pour API complète), évolutivité sans modification du serveur MCP

- Inconvénient : nécessité d’une recherche sémantique performante, typage dynamique des paramètres

Implications techniques :

- L’approche Cloudflare déplaçait la complexité de la définition d’outils vers la recherche sémantique et la documentation d’opérations

- Les modèles de langage devaient désormais gérer une phase de découverte (search) avant exécution, introduisant une latence supplémentaire mais préservant le contexte

- Cette architecture était particulièrement adaptée aux APIs massives (centaines d’endpoints) mais potentiellement excessive pour des services simples (quelques opérations)

Recommandation émergente : Utiliser des outils spécialisés pour APIs compactes (< 20 opérations), adopter l'approche générique pour APIs étendues (> 50 opérations).

API Real-time Search – Réponses en Langage Naturel

L’API Real-time Search (RTS) de Slack introduisait un paradigme d’interaction novateur pour les agents IA :

Approche traditionnelle (API REST) :

- Requête : GET /conversations.history?channel=C123&limit=10

- Réponse : JSON structuré avec métadonnées (timestamps, user IDs, thread structure)

- Traitement : l’agent devait parser, filtrer et reformuler l’information

Approche RTS (réponses NL) :

- Requête : “Quels sont les derniers messages sur le projet Alpha ?”

- Réponse : “Les 3 derniers messages concernant le projet Alpha discutaient du déploiement prévu pour mars, avec Sarah mentionnant un retard potentiel et Marc proposant une solution de contournement.”

- Traitement : l’agent recevait directement l’information contextualisée en langage naturel

Avantages techniques :

- Réduction tokens : élimination des métadonnées superflues (IDs techniques, timestamps bruts)

- Contextualisation serveur : la compréhension sémantique était déléguée à l’API plutôt qu’au modèle

- Simplification prompts : moins de post-traitement nécessaire côté agent

Défis identifiés :

- Perte de contrôle : l’agent ne pouvait pas accéder aux métadonnées brutes si nécessaire

- Opacité du filtrage : les critères de sélection/résumé de l’API RTS n’étaient pas transparents

- Dépendance modèle : la qualité des réponses NL dépendait du modèle utilisé côté Slack

Cas d’usage recommandés :

- RTS : recherche exploratoire, résumés conversationnels, questions ouvertes

- API REST : extraction de données structurées, intégrations système, analyses quantitatives

MCP Enforcement Mode – Architecture d’Audit

Bien que la proposition « MCP Enforcement Mode » discutée le 18 février 2026 n’était pas encore spécifiée en détail, les discussions GitHub suggéraient une architecture comportant :

Composants envisagés :

- Audit Logger : enregistrement systématique de toutes les interactions MCP (requêtes, réponses, erreurs)

- Permission Validator : vérification des autorisations avant exécution d’opérations sensibles

- Policy Engine : application de règles enterprise (restrictions horaires, validation multi-étapes, approbation manuelle)

- Compliance Reporter : génération de rapports pour audits de conformité

Flux d’interaction envisagé :

- Agent envoie une requête MCP (exemple : slack_send_message)

- Permission Validator vérifie les autorisations (l’agent a-t-il le droit d’envoyer dans ce canal ?)

- Policy Engine applique les règles enterprise (exemple : messages > 1000 caractères nécessitent validation)

- Audit Logger enregistre la requête avec contexte (timestamp, agent ID, justification)

- Opération exécutée ou rejetée

- Audit Logger enregistre le résultat

Cas d’usage enterprise :

- Conformité RGPD : traçabilité des accès aux données personnelles

- SOC 2 : démonstration des contrôles d’accès et de la ségrégation des privilèges

- Incident Response : analyse forensique des actions d’agents en cas d’incident

- Validation réglementaire : approbation manuelle pour opérations critiques (suppression de données, accès privilégiés)

Défis techniques anticipés :

- Performance : l’overhead d’audit et de validation ne devait pas dégrader l’expérience utilisateur

- Granularité : définir le niveau de détail approprié pour les logs (trop verbeux = coûts stockage, trop sommaire = audits inefficaces)

- Rétrocompatibilité : l’Enforcement Mode devait être optionnel pour ne pas briser les implémentations existantes

Optimisation Token – Stratégies Émergentes

Les annonces Slack et Cloudflare de la semaine du 16 au 22 février 2026 révélaient des stratégies convergentes d’optimisation de consommation token :

1. Condensation d’outils (Cloudflare) :

- Réduction de N outils spécialisés à 2 outils génériques

- Économie estimée : 90-95% de tokens pour la déclaration d’outils

- Contrepartie : coût de recherche sémantique (requête search() supplémentaire)

2. Réponses en langage naturel (Slack RTS) :

- Élimination des métadonnées JSON superflues

- Économie estimée : 40-60% de tokens pour les réponses (selon complexité données)

- Contrepartie : perte de granularité pour traitements structurés

3. Découverte progressive (pattern émergent) :

- Ne charger que les outils MCP nécessaires au contexte courant (vs. chargement exhaustif)

- Exemple : dans une conversation sur DNS, ne charger que les outils Cloudflare liés à DNS

- Économie potentielle : 70-80% de tokens pour APIs modulaires

- Défi : nécessite une capacité de raisonnement pour déterminer les outils pertinents

Métriques de référence (estimation basée sur annonces) :

- Approche traditionnelle : 50-100 tokens par outil spécialisé

- Cloudflare Code Mode : ~500 tokens par outil générique (description + schéma opérations)

- API RTS Slack : ~30-50% de réduction sur volume réponses vs. REST

Recommandation architecturale : Combiner les approches selon le contexte : outils génériques pour APIs étendues, réponses NL pour données conversationnelles, découverte progressive pour écosystèmes modulaires.

Conclusion

La semaine du 16 au 22 février 2026 a marqué une étape déterminante dans la maturation du protocole Model Context Protocol. Les intégrations officielles de Slack et Cloudflare ont démontré la viabilité de MCP pour des cas d’usage enterprise critiques, tout en révélant des paradigmes architecturaux innovants susceptibles de devenir des standards de l’industrie.

Développements clés :

- Adoption enterprise confirmée : deux acteurs infrastructure majeurs (collaboration et cloud) ont officialisé leurs serveurs MCP

- Innovation architecturale : l’approche minimaliste de Cloudflare (2 outils génériques) a proposé une alternative crédible à la prolifération d’outils spécialisés

- Optimisation ressources : les stratégies d’économie de tokens (condensation, réponses NL) ont répondu aux contraintes de fenêtre de contexte des LLM

- Gouvernance structurée : la proposition MCP Enforcement Mode a signalé une prise en compte des exigences de conformité enterprise

Tensions identifiées :

- Complexité vs. simplicité : les débats Hacker News ont révélé une divergence entre la valeur de MCP pour architectures distribuées et son overhead pour workflows locaux

- Standardisation vs. agilité : la donation à la Linux Foundation a soulevé des questions sur la capacité d’itération rapide du protocole

- Généricité vs. spécialisation : les approches Cloudflare (outils génériques) et traditionnelle (outils spécialisés) représentaient des compromis différents entre optimisation tokens et clarté fonctionnelle

Perspectives pour les semaines suivantes :

- Court terme : observation de l’adoption des patterns Slack RTS et Cloudflare Code Mode par d’autres fournisseurs

- Moyen terme : spécification détaillée et implémentation de MCP Enforcement Mode pour adoption enterprise

- Long terme : émergence potentielle de profils MCP différenciés (« MCP Lite » pour usage local, « MCP Enterprise » pour production) pour réconcilier les cas d’usage divergents

La semaine 8 de 2026 positionnait MCP à un point d’inflexion : suffisamment mature pour attirer des acteurs critiques, suffisamment jeune pour évoluer rapidement selon les retours terrain. Les mois suivants détermineraient si le protocole parvenait à maintenir cet équilibre entre standardisation et agilité.

Glossaire – Pour Mieux Comprendre

API (Application Programming Interface) : Interface de programmation qui permet à deux logiciels de communiquer entre eux. C’est comme un menu de restaurant qui liste ce que vous pouvez commander et comment le demander. Par exemple, l’API de Slack permet à d’autres programmes d’envoyer des messages ou de lire des conversations.

Agent IA : Programme informatique utilisant l’intelligence artificielle pour effectuer des tâches de manière autonome. Comparable à un assistant virtuel qui peut comprendre vos demandes en langage naturel et agir en conséquence (rechercher des informations, exécuter des commandes, etc.).

Audit Logger : Composant qui enregistre systématiquement toutes les actions effectuées dans un système, comme un journal de bord. Essentiel pour la sécurité et la conformité réglementaire, il permet de reconstituer qui a fait quoi et quand.

Cloudflare : Entreprise fournissant des services d’infrastructure internet (sécurité, performance, hébergement). Comme un système de protection et d’accélération pour les sites web, Cloudflare se place entre les visiteurs et les serveurs pour optimiser et sécuriser les échanges.

CLI (Command Line Interface) : Interface en ligne de commande où l’utilisateur tape des instructions textuelles plutôt que d’utiliser une interface graphique. Comparable à donner des ordres écrits à un ordinateur plutôt que de cliquer sur des boutons.

Code Mode : Approche architecturale développée par Cloudflare pour MCP, condensant l’accès à toute son API en seulement deux outils génériques (search et execute). Comme avoir un couteau suisse à deux lames au lieu d’une boîte à outils complète.

Conformité (Compliance) : Respect des règles, normes et réglementations applicables à une organisation. Par exemple, la conformité RGPD garantit que les données personnelles sont traitées selon la législation européenne.

Contexte (fenêtre de) : Quantité d’informations qu’un modèle d’IA peut traiter simultanément. Comparable à la mémoire à court terme d’une personne : plus la fenêtre est grande, plus le modèle peut considérer d’informations, mais cela consomme des ressources.

CVE (Common Vulnerabilities and Exposures) : Système de référencement des failles de sécurité informatique. Chaque vulnérabilité découverte reçoit un numéro CVE unique, permettant de la suivre et de coordonner les correctifs.

DNS (Domain Name System) : Système qui traduit les noms de domaine (comme example.com) en adresses IP que les ordinateurs utilisent pour communiquer. C’est l’annuaire téléphonique d’internet.

Endpoint : Point d’accès spécifique dans une API permettant d’effectuer une opération précise. Comme une porte d’entrée dédiée dans un bâtiment, chaque endpoint a une fonction spécifique (créer un utilisateur, récupérer des données, etc.).

Enforcement Mode : Mode de fonctionnement strict appliquant des règles de sécurité et d’audit. Proposition pour MCP visant à ajouter des contrôles renforcés pour les environnements professionnels exigeants (traçabilité, validation, conformité).

GitHub : Plateforme d’hébergement de code source permettant la collaboration entre développeurs. Comme un Google Docs pour le code, avec historique des modifications et gestion des contributions multiples.

Hacker News : Site communautaire populaire où les professionnels de la technologie discutent d’actualités, de tendances et de développements techniques. Comparable à un forum spécialisé avec une communauté technique très active.

JSON (JavaScript Object Notation) : Format de données structurées utilisé pour échanger des informations entre systèmes. Comme un formulaire standardisé avec des champs prédéfinis, JSON organise l’information de manière compréhensible par les machines.

Linux Foundation : Organisation à but non lucratif hébergeant et soutenant des projets open source majeurs. Comme une fondation académique pour le logiciel libre, elle fournit gouvernance, ressources et coordination pour des projets technologiques d’envergure.

LLM (Large Language Model) : Modèle d’intelligence artificielle entraîné sur d’énormes quantités de texte pour comprendre et générer du langage naturel. Exemples : GPT-4, Claude. Ces modèles peuvent converser, rédiger, traduire et raisonner à partir de texte.

MCP (Model Context Protocol) : Protocole standardisant la communication entre modèles d’IA et outils externes. Comme un langage commun permettant aux agents IA d’interagir avec diverses applications (Slack, bases de données, APIs) de manière cohérente.

Métadonnées : Données décrivant d’autres données. Par exemple, pour une photo : date de prise, appareil utilisé, localisation. Les métadonnées fournissent le contexte sans être le contenu principal.

OAuth : Protocole d’autorisation permettant à une application d’accéder à des ressources d’un utilisateur sans recevoir son mot de passe. Comme donner une clé temporaire à quelqu’un pour accéder à une pièce spécifique, sans lui donner le trousseau complet.

Overhead : Surcoût en ressources (temps, mémoire, complexité) introduit par un système ou une couche logicielle. Comparable aux frais administratifs dans une entreprise : nécessaires mais ne contribuant pas directement à la production.

Parser : Analyser et décomposer des données structurées pour en extraire l’information pertinente. Comme lire un document et en extraire les points importants en ignorant la mise en forme.

Permission : Autorisation d’effectuer une action spécifique dans un système. Les permissions définissent qui peut lire, modifier ou supprimer des données, garantissant la sécurité et la confidentialité.

Protocole : Ensemble de règles standardisées définissant comment des systèmes communiquent. Comparable aux règles de politesse : tout le monde doit les suivre pour que la communication soit efficace.

Rate Limit : Limitation du nombre de requêtes qu’un utilisateur peut effectuer dans un intervalle de temps. Comme un quota, cela prévient la surcharge des serveurs et garantit un accès équitable pour tous.

Real-time Search (RTS) : API développée par Slack fournissant des réponses en langage naturel plutôt que des structures de données brutes. Au lieu de renvoyer du JSON technique, RTS formule des réponses compréhensibles directement.

Repository (repo) : Espace de stockage centralisé pour un projet de code source, généralement sur GitHub. Comme un dossier partagé contenant tous les fichiers du projet, son historique et sa documentation.

REST (REpresentational State Transfer) : Style d’architecture pour concevoir des APIs utilisant les méthodes HTTP standard (GET, POST, etc.). Approche dominante pour les services web, REST définit des conventions pour manipuler des ressources.

RGPD (Règlement Général sur la Protection des Données) : Réglementation européenne sur la confidentialité et la protection des données personnelles. Impose des obligations strictes aux organisations traitant des données de citoyens européens.

SDK (Software Development Kit) : Ensemble d’outils facilitant le développement d’applications pour une plateforme spécifique. Comme une boîte à outils pour constructeurs, un SDK fournit bibliothèques, documentation et exemples de code.

Serveur MCP : Programme implémentant le protocole MCP pour exposer des fonctionnalités spécifiques aux agents IA. Par exemple, le serveur MCP Slack permet aux agents d’interagir avec les espaces de travail Slack.

Slack : Plateforme de communication professionnelle organisant les conversations en canaux thématiques. Outil collaboratif très utilisé en entreprise pour messagerie instantanée, partage de fichiers et intégrations d’applications.

SOC 2 (Service Organization Control 2) : Standard d’audit certifiant qu’une organisation implémente des contrôles de sécurité appropriés. Essentiel pour les fournisseurs de services cloud vendant à des entreprises exigeantes.

SRE (Site Reliability Engineering) : Discipline combinant développement logiciel et opérations système pour garantir la fiabilité des services. Les SRE automatisent les tâches d’infrastructure et assurent la disponibilité des applications.

Token : Unité de texte traitée par un modèle d’IA (environ 0,75 mot en anglais). Les modèles ont des limites de tokens (contexte) et leur utilisation est souvent facturée au token. Optimiser la consommation token réduit les coûts et améliore les performances.

Troubleshooting : Processus de diagnostic et de résolution de problèmes techniques. Comme un mécanicien identifiant une panne, le troubleshooting suit une méthodologie pour isoler et corriger des dysfonctionnements.

Workspace : Espace de travail partagé dans une application collaborative comme Slack. Contient les canaux, membres et paramètres d’une organisation ou d’un projet.

Zero Trust : Modèle de sécurité ne faisant confiance à aucun utilisateur ou système par défaut, même à l’intérieur du réseau. Chaque accès doit être vérifié et autorisé explicitement, contrairement aux approches traditionnelles faisant confiance au périmètre interne.